اتبع تطور الصناعة بأسرع ما يمكن منظمة العفو الدولية يمثل تحديا كبيرا. وإلى أن يتمكن الذكاء الاصطناعي من القيام بذلك نيابةً عنك، إليك ملخصًا مفيدًا للقصص الحديثة في عالم التعلم الآلي، بالإضافة إلى الأبحاث والتجارب البارزة التي لم نغطيها بمفردنا.

هذا الأسبوع في الذكاء الاصطناعي، جوجل في استراحة قدرة برنامج الدردشة الآلي Gemini الخاص بها والذي يعمل بالذكاء الاصطناعي على إنشاء صور للأشخاص بعد أن اشتكى قطاع من المستخدمين من عدم الدقة التاريخية. على سبيل المثال، لتصوير “الفيلق الروماني”، سيُظهر الجوزاء مجموعة كاريكاتورية عفا عليها الزمن من جنود المشاة المتنوعين عرقيًا بينما يعرض “محاربو الزولو” باللون الأسود.

يبدو أن جوجل – مثل بائعي الذكاء الاصطناعي الآخرين بما في ذلك OpenAI – قد نفذت بعض الترميز الثابت تحت الغطاء لمحاولة “تصحيح” التحيزات في نموذجها. ردًا على طلبات مثل “أرني صورًا للنساء فقط” أو “أرني صورًا للرجال فقط”، ترفض جيميني، مدعيةً أن مثل هذه الصور يمكن أن “تساهم في استبعاد وتهميش الأنواع الأخرى”. كان مواليد الجوزاء أيضًا مترددين في إنشاء صور لأشخاص يتم تحديدهم فقط من خلال عرقهم – على سبيل المثال “الأشخاص البيض” أو “الأشخاص السود” – بسبب اهتمام واضح بـ “اختزال الأفراد في خصائصهم الجسدية”.

وقد تمسك اليمين بهذه الأخطاء كدليل على أجندة “اليقظة” التي تديمها النخبة التكنولوجية. لكنك لا تحتاج إلى شفرة أوكام لرؤية الحقيقة الأقل ضررًا: جوجل، الذي احترق ذات يوم بسبب تحيزات أدواته (انظر: تصنيف الرجال السود على أنهم غوريلابنادق حرارية مربكة في أيدي السود كأسلحةوما إلى ذلك)، فهو يائس للغاية لتجنب تكرار التاريخ نفسه لدرجة أنه يُظهر عالمًا أقل تحيزًا في نماذجه المولدة للصور – مهما كانت معيبة.

في كتابها الأكثر مبيعا “هشاشة البيض”، تشرح المربية المناهضة للعنصرية روبن ديانجيلو كيف يساهم المحو العنصري – “عمى الألوان”، كما تقول عبارة أخرى – في اختلال توازن القوى العرقية المنهجي بدلا من تخفيفه أو الحد منه. من خلال الادعاء بـ “عدم رؤية اللون” أو تعزيز فكرة أن مجرد الاعتراف بنضالات الأشخاص من الأعراق الأخرى يكفي ليطلق على نفسه اسم “مستيقظ”، فإن الناس تخليد يقول ديانجيلو: “إنها تضر من خلال تجنب أي تحفظ كبير حول هذا الموضوع”.

إن معالجة جوجل المنفردة للمطالبات القائمة على العرق في برج الجوزاء لم تتجنب المشكلة في حد ذاتها ــ ولكنها حاولت نفاقاً التغطية على أسوأ التحيزات في النموذج. يمكن للمرء أن يجادل (والعديد منهم) أنه لا ينبغي تجاهل هذه التحيزات أو التغاضي عنها، بل يجب معالجتها في السياق الأوسع لبيانات التدريب التي تنشأ منها، أي المجتمع على شبكة الويب العالمية.

نعم، تحتوي مجموعات البيانات المستخدمة لتدريب مولدات الصور بشكل عام على عدد أكبر من الأشخاص البيض مقارنة بالسود، ونعم، صور الأشخاص السود في مجموعات البيانات هذه تعزز الصور النمطية السلبية. هذا هو السبب في مولدات الصور إضفاء الطابع الجنسي على بعض النساء ذوات البشرة الملونة, يصور الرجال البيض في مناصب السلطة وتفضل عموما وجهات نظر غربية غنية.

قد يجادل البعض بأنه لا يوجد مكسب لجميع الأطراف في مجال الذكاء الاصطناعي. وسواء تعاملوا مع التحيزات النموذجية ــ أو اختاروا عدم معالجتها ــ فسوف يتعرضون للانتقاد. و هذا صحيح. ولكنني أفترض أن هذه النماذج، على نحو ما، تفتقر إلى التفسيرات ــ فهي مقدمة بطريقة تقلل من أهمية كيفية ظهور تحيزاتها.

إذا عالج بائعو الذكاء الاصطناعي العيوب في نماذجهم بشكل مباشر، بلغة متواضعة وشفافة، فسوف يذهب هذا إلى أبعد من المحاولات العشوائية “لإصلاح” ما يعتبر في الأساس تحيزًا لا يمكن إصلاحه. والحقيقة هي أننا جميعا لدينا تحيزات – ونتيجة لذلك، فإننا لا نعامل الناس بنفس الطريقة. ولا النماذج التي نبنيها. ومن الجيد أن ندرك ذلك.

فيما يلي بعض قصص الذكاء الاصطناعي الأخرى المثيرة للاهتمام من الأيام الأخيرة:

- المرأة في الذكاء الاصطناعي: أطلقت TechCrunch سلسلة تسلط الضوء على النساء المتميزات في مجال الذكاء الاصطناعي. اقرأ القائمة هنا.

- بث مستقر v3: أعلنت Stability AI عن Stable Diffusion 3، وهو الإصدار الأحدث والأقوى من نموذج الذكاء الاصطناعي لتوليد الصور الخاص بالشركة، والذي يعتمد على بنية جديدة.

- يحصل Chrome على GenAI: تتيح أداة Gemini الجديدة من Google في Chrome للمستخدمين إعادة كتابة النص الموجود على الويب أو إنشاء شيء جديد تمامًا.

- أكثر سوادًا من ChatGPT: قامت وكالة الإعلانات الإبداعية McKinney بتطوير اختبار بعنوان “هل أنت أكثر سوادًا من ChatGPT؟” لتسليط الضوء على تحيز الذكاء الاصطناعي.

- مطالبات بقوانين: وقع المئات من الشخصيات البارزة في مجال الذكاء الاصطناعي على رسالة عامة في وقت سابق من هذا الأسبوع تدعو إلى سن تشريعات لمكافحة التزييف العميق في الولايات المتحدة.

- المباراة التي تم إجراؤها في الذكاء الاصطناعي: لدى OpenAI عميل جديد في Match Group، مالك تطبيقات مثل Hinge وTinder وMatch، والذي سيستخدم موظفوه تقنية OpenAI للذكاء الاصطناعي لإكمال المهام المتعلقة بالعمل.

- أمن ديب مايند: أنشأ DeepMind، قسم أبحاث الذكاء الاصطناعي في Google، منظمة جديدة، AI Safety and Alignment، تتألف من فرق موجودة تعمل على سلامة الذكاء الاصطناعي، ولكنها توسعت أيضًا لتشمل مجموعات متخصصة جديدة من الباحثين ومهندسي GenAI.

- النماذج المفتوحة: بالكاد مر أسبوع على إطلاق الإصدار الأخير منه نماذج الجوزاءأطلقت Google Gemma، وهي عائلة جديدة من القوالب خفيفة الوزن والمفتوحة.

- مجموعة عمل الغرفة: لقد أنشأ مجلس النواب الأمريكي فريق عمل للذكاء الاصطناعي يبدو، كما كتب ديفين، وكأنه تلاعب بالكلمات بعد سنوات من التردد الذي لا تظهر عليه أي علامات على النهاية.

المزيد من التعلم الآلي

يبدو أن نماذج الذكاء الاصطناعي تعرف الكثير، ولكن ما مدى معرفتها حقًا؟ حسنا، الجواب لا شيء. لكن إذا قمت بصياغة السؤال بشكل مختلف قليلاً… فيبدو أنهم استوعبوا بعض “المعاني” المشابهة لما يعرفه البشر. على الرغم من عدم وجود الذكاء الاصطناعي الذي يفهم حقًا ما هو القط أو الكلب، فهل يمكن أن يكون لديه بعض التشابه المشفر في تكامل هاتين الكلمتين المختلفتين من، على سبيل المثال، قطة وزجاجة؟ يعتقد الباحثون في أمازون ذلك.

Leurs recherches ont comparé les « trajectoires » de phrases similaires mais distinctes, comme « le chien a aboyé après le cambrioleur » et « le cambrioleur a fait aboyer le chien », avec celles de phrases grammaticalement similaires mais différentes, comme « un chat dort toute اليوم “. و”فتاة تركض طوال فترة ما بعد الظهر”. ووجدوا أن تلك التي قد يجدها البشر متشابهة تم التعامل معها داخليًا على أنها أكثر تشابهًا على الرغم من اختلافها نحويًا، والعكس صحيح بالنسبة للمتشابهة نحويًا. حسنًا، أشعر أن هذه الفقرة كانت مربكة بعض الشيء، ولكن يكفي أن أقول إن المعاني المشفرة في LLMs تبدو أكثر قوة وتطورًا مما كان متوقعًا، وليست ساذجة تمامًا.

الترميز العصبي أثبت فائدته في الرؤية الاصطناعية اكتشف باحثون سويسريون من EPFL. تتمتع شبكية العين الاصطناعية وغيرها من وسائل استبدال أجزاء من النظام البصري البشري بشكل عام بدقة محدودة للغاية بسبب القيود المفروضة على صفائف الأقطاب الكهربائية الدقيقة. ولذلك، مهما كانت درجة تفاصيل الصورة المستلمة، يجب أن يتم نقلها بدقة منخفضة للغاية. ولكن هناك طرق مختلفة لأخذ العينات الفرعية، وقد وجد هذا الفريق أن التعلم الآلي يقوم بعمل رائع في هذا الشأن.

اعتمادات الصورة: EPFL

“لقد وجدنا أنه إذا طبقنا نهجًا قائمًا على التعلم، فقد حصلنا على نتائج أفضل من حيث التشفير الحسي الأمثل. وقال دييغو جيزي في بيان صحفي: “لكن الشيء الأكثر إثارة للدهشة هو أنه عندما استخدمنا شبكة عصبية غير مقيدة، تعلمت تقليد جوانب معينة من معالجة الشبكية نفسها”. هذا هو في الأساس ضغط إدراكي. لقد اختبروه على شبكية أعين الفئران، لذا فهو ليس نظريًا فقط.

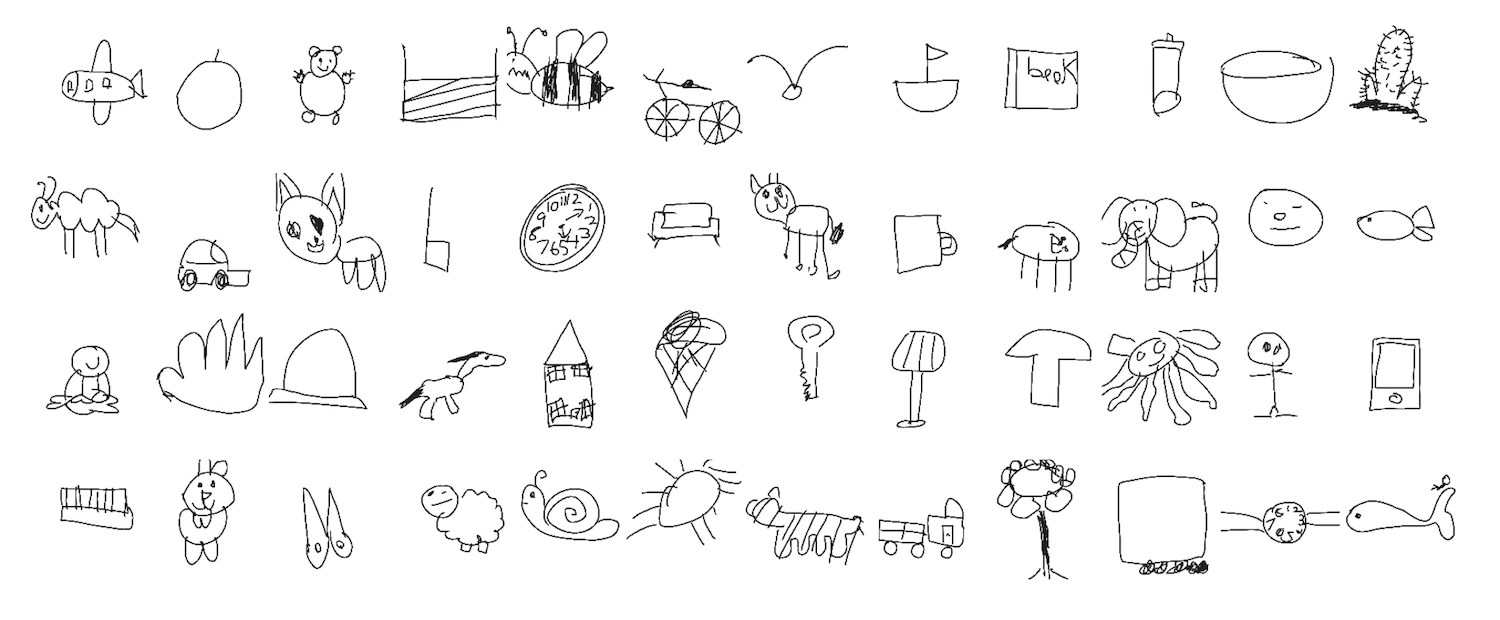

يشير تطبيق مثير للاهتمام للرؤية الحاسوبية أجراه باحثون في جامعة ستانفورد إلى لغز يكتنف كيفية تطوير الأطفال لمهاراتهم في الرسم. قام الفريق بالتماس وتحليل 37000 رسمة للأطفال تصور أشياء وحيوانات مختلفة، وكذلك (بناءً على ردود الأطفال) مدى سهولة التعرف على كل رسم. ومن المثير للاهتمام، أنه لم يكن مجرد إدراج السمات المميزة مثل آذان الأرنب هو ما جعل الرسومات أكثر قابلية للتعرف على الأطفال الآخرين.

“إن أنواع الميزات التي تجعل رسومات الأطفال الأكبر سنًا يمكن التعرف عليها لا يبدو أنها مدفوعة بميزة واحدة يتعلم جميع الأطفال الأكبر سنًا تضمينها في رسوماتهم. وقالت جوديث فان، الباحثة الرئيسية: “إنه أمر أكثر تعقيدًا بكثير تعالجه أنظمة التعلم الآلي”.

تم العثور على الكيميائيين (أيضًا في EPFL). أن LLMs أيضًا ماهرون بشكل مدهش في مساعدتهم في عملهم بعد الحد الأدنى من التدريب. لا يقتصر الأمر على القيام بالكيمياء بشكل مباشر فحسب، بل يتعلق الأمر أيضًا بتحسين مجموعة من الأعمال التي لا يستطيع الكيميائيون الأفراد معرفتها كلها. على سبيل المثال، في آلاف المقالات قد يكون هناك بضع مئات من البيانات حول ما إذا كانت السبيكة ذات الإنتروبيا العالية هي أحادية الطور أم متعددة الأطوار (لست بحاجة إلى معرفة ما يعنيه ذلك – فهو كذلك). يمكن تدريب النظام (المعتمد على GPT-3) على هذه الأنواع من الأسئلة والأجوبة بنعم/لا، وسيكون قادرًا قريبًا على استقراء ذلك.

وهذا ليس إنجازًا كبيرًا، ولكنه مجرد دليل إضافي على أن LLMs هي أداة مفيدة بهذا المعنى. وقال الباحث بيريند سميت: “الحقيقة هي أن الأمر بسيط مثل إجراء بحث في الأدبيات، وهو ما يصلح للعديد من المشكلات الكيميائية”. “إن استجواب النموذج الأساسي يمكن أن يصبح وسيلة شائعة لبدء المشروع.”

آخر، كلمة تحذير من الباحثين في بيركلي، ولكن الآن بعد أن أعدت قراءة المقال، أرى أن EPFL كان متورطًا أيضًا في هذا المقال. الذهاب لوزان! ووجدت المجموعة أن الصور التي تم العثور عليها من خلال جوجل كانت أكثر عرضة لتعزيز الصور النمطية الجنسانية لوظائف وكلمات معينة مقارنة بالنصوص التي تشير إلى نفس الشيء. وكان هناك أيضًا عدد أكبر من الرجال في كلتا الحالتين.

ليس هذا فحسب، بل وجدوا في إحدى التجارب أن الأشخاص الذين نظروا إلى الصور بدلاً من قراءة النص عند البحث عن الأدوار، ربطوا تلك الأدوار بالجنس بشكل أكثر موثوقية، حتى بعد أيام. وقال الباحث دوجلاس جيلبولت: “الأمر لا يتعلق فقط بتكرار التحيز الجنسي على الإنترنت”. “جزء من القصة هنا هو أن هناك شيئًا لزجًا جدًا وقويًا جدًا فيما يتعلق بتمثيل الصور للأشخاص الذي لا يحتوي عليه النص.”

مع أشياء مثل الخلاف حول تنوع مولدات الصور من Google، من السهل أن نغفل الحقيقة الراسخة والتي يتم التحقق منها بشكل متكرر وهي أن مصدر البيانات للعديد من نماذج الذكاء الاصطناعي لديه تحيزات خطيرة، وهذا التحيز له تأثير حقيقي على الناس.

Source link