المملكة المتحدة تفتتح مكتبًا في سان فرانسيسكو لمعالجة مخاطر الذكاء الاصطناعي

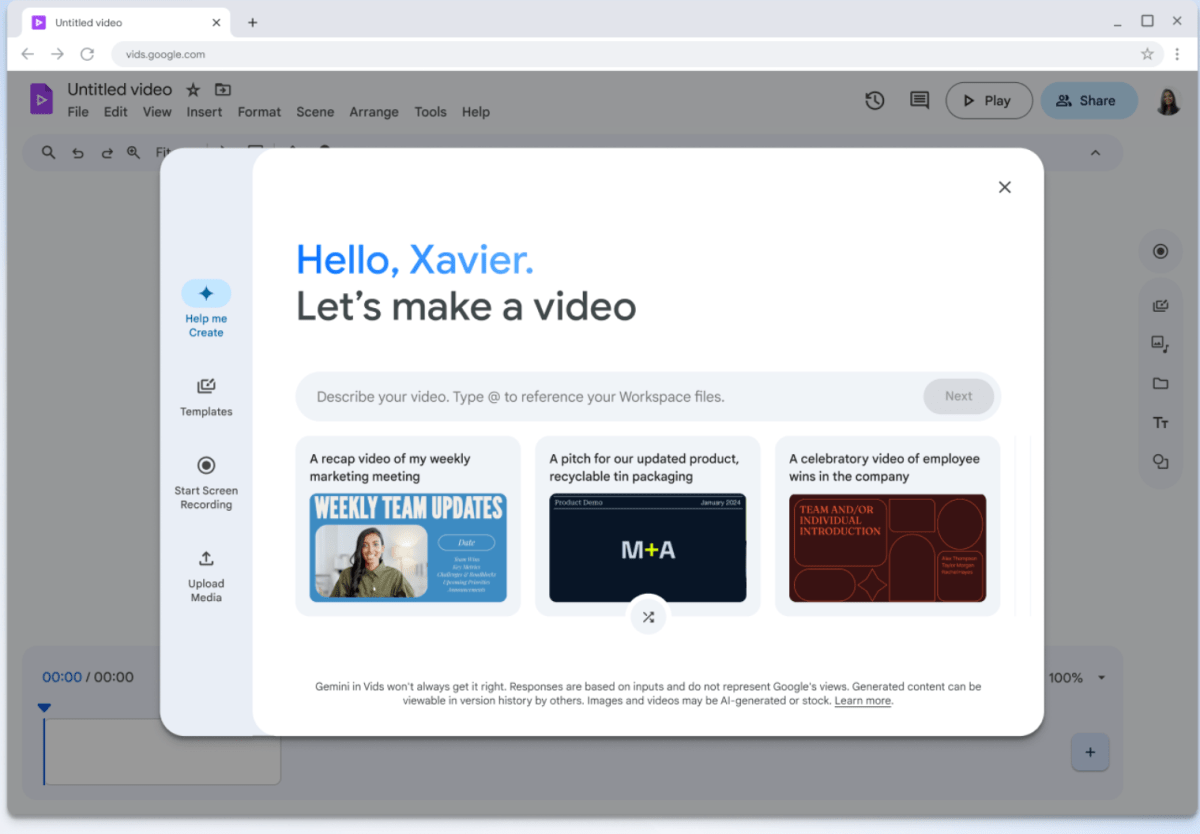

قبل انطلاق قمة أمن الذكاء الاصطناعي في سيول بكوريا الجنوبية لاحقا في هذا الاسبوعوتعمل المملكة المتحدة، التي تشارك في استضافة المؤتمر، على توسيع جهودها في هذا المجال. أعلن معهد سلامة الذكاء الاصطناعي – وهو منظمة بريطانية أنشئت في نوفمبر 2023 بهدف طموح يتمثل في تقييم وإدارة المخاطر المرتبطة بمنصات الذكاء الاصطناعي – أنه سيفتتح موقعا ثانيا… في سان فرانسيسكو.

تتمثل الفكرة في الاقتراب مما يعتبر حاليًا مركز تطوير الذكاء الاصطناعي، حيث تعد منطقة الخليج موطنًا لـ OpenAI وAnthropic وGoogle وMeta، من بين آخرين، لتطوير تكنولوجيا الذكاء الاصطناعي الأساسية.

النماذج الأساسية هي اللبنات الأساسية لخدمات الذكاء الاصطناعي التوليدية وغيرها من التطبيقات، ومن المثير للاهتمام ملاحظة أنه على الرغم من أن المملكة المتحدة وقعت مذكرة تفاهم مع الولايات المتحدة للتعاون بين البلدين في مبادرات أمن الذكاء الاصطناعي، إلا أن المملكة المتحدة لا تزال تختار الاستثمار في إنشاء وجود مباشر في الولايات المتحدة لمعالجة هذه القضية.

وقالت ميشيل دونيلان، وزيرة الدولة البريطانية للعلوم والابتكار والتكنولوجيا، في مقابلة مع موقع TechCrunch: “من خلال وجود أشخاص على الأرض في سان فرانسيسكو، سيتيح لهم ذلك الوصول إلى المقر الرئيسي للعديد من شركات الذكاء الاصطناعي هذه”. “لدى عدد منهم قواعد هنا في المملكة المتحدة، لكننا نعتقد أنه سيكون من المفيد جدًا أن يكون لدينا قاعدة هناك أيضًا، لنتمكن من الوصول إلى مجموعة إضافية من المواهب ولنكون قادرين على العمل بشكل أكثر تعاونًا ويدًا بيد. . مع الولايات المتحدة. »

ويرجع ذلك جزئيًا إلى أن الاقتراب من هذا المركز، بالنسبة للمملكة المتحدة، مفيد ليس فقط لفهم ما يتم بناؤه، ولكن أيضًا لأنه يمنح المملكة المتحدة رؤية أكبر لهذه الشركات – وهو أمر مهم، نظرًا لأن الذكاء الاصطناعي والتكنولوجيا بشكل عام وتعتبر المملكة المتحدة فرصة كبيرة للنمو الاقتصادي والاستثمار.

ونظرًا لأحدث دراما OpenAI المحيطة بها فريق المحاذاة الفائقةيبدو أن هذا هو الوقت المناسب بشكل خاص لتأسيس وجود هناك.

يعد معهد سلامة الذكاء الاصطناعي، الذي سيتم إطلاقه في نوفمبر 2023، أمرًا متواضعًا نسبيًا حاليًا. لدى المنظمة الآن 32 شخصًا فقط يعملون هناك، وهو ما يمثل ديفيد حقيقي مقابل جالوت في مجال تكنولوجيا الذكاء الاصطناعي، مع الأخذ في الاعتبار مليارات الدولارات من الاستثمارات التي تعتمد على الشركات التي تبني نماذج الذكاء الاصطناعي، وبالتالي دوافعها الاقتصادية للحصول على تقنياتها. خارج الباب وفي أيدي المستخدمين الذين يدفعون.

كان أحد أبرز التطورات التي قام بها معهد سلامة الذكاء الاصطناعي هو الإصدار في وقت سابق من هذا الشهر فحصأول مجموعة من الأدوات لاختبار أمان نماذج الذكاء الاصطناعي الأساسية.

أطلق دونيلان اليوم على الإصدار اسم “المرحلة الأولى”. ليس هو فقط ثبت أنه صعب حتى الآن، إلى النماذج المرجعية، ولكن في الوقت الحالي فإن الالتزام هو في الأساس اتفاق طوعي وغير متسق. وكما أشار مصدر كبير في هيئة تنظيمية في المملكة المتحدة، فإن الشركات ليست ملزمة قانوناً بفحص نماذجها في هذه المرحلة؛ وليست جميع الشركات على استعداد للتحقق من نماذجها قبل الإصدار. قد يعني هذا أنه في الحالات التي يمكن فيها تحديد الخطر، فمن الممكن أن يكون الحصان قد هرب بالفعل.

وقال دونيلان إن معهد سلامة الذكاء الاصطناعي لا يزال يطور أفضل السبل للتعاون مع شركات الذكاء الاصطناعي لتقييمها. وقالت: “إن عملية التقييم لدينا هي علم ناشئ في حد ذاته”. “وبالتالي، مع كل تقييم، سنقوم بتطوير العملية وتحسينها بشكل أكبر. »

وقال دونيلان إن أحد الأهداف في سيول سيكون تقديم Inspect إلى المنظمين المجتمعين في القمة، بهدف حملهم على اعتماده أيضًا.

“لدينا الآن نظام تقييم. وقالت: “يجب أن تهدف المرحلة الثانية أيضًا إلى جعل الذكاء الاصطناعي آمنًا في المجتمع”.

على المدى الطويل، يعتقد دونيلان أن المملكة المتحدة ستضع المزيد من تشريعات الذكاء الاصطناعي، على الرغم من تكرار ما قاله رئيس الوزراء ريشي سوناك حول هذا الموضوع، فإنها ستقاوم حتى تفهم بشكل أفضل مدى المخاطر المرتبطة بالذكاء الاصطناعي.

وقالت: “لا نؤمن بالتشريع قبل الإتقان الجيد والفهم الكامل”، مشيرة إلى أن التقرير الدولي الأخير حول أمن الذكاء الاصطناعي، الذي نشره المعهد، يهدف في المقام الأول إلى محاولة الحصول على صورة كاملة عن الأبحاث حتى الآن، “أبرز أن هناك فجوات كبيرة مفقودة وأننا بحاجة إلى تحفيز وتشجيع المزيد من الأبحاث على مستوى العالم.

“ويستغرق الأمر أيضًا حوالي عام للتشريع في المملكة المتحدة. ولو كنا قد بدأنا للتو في التشريع بدلاً من عقد قمة أمن الذكاء الاصطناعي (التي عقدت في نوفمبر من العام الماضي)، لكنا لا نزال نقوم بالتشريع الآن، ولن يكون لدينا في الواقع ما نثبته”.

وقال إيان هوغارث، رئيس المعهد: “منذ اليوم الأول للمعهد، أوضحنا أهمية اتباع نهج دولي لأمن الذكاء الاصطناعي، وتبادل الأبحاث والعمل بشكل تعاوني مع الدول الأخرى لاختبار النماذج وتوقع المخاطر المرتبطة بالذكاء الاصطناعي المتقدم”. المعهد. معهد أمن الذكاء الاصطناعي. “يمثل اليوم لحظة محورية تسمح لنا بتعزيز هذه الأجندة، ونحن فخورون بتوسيع عملياتنا في منطقة تعج بالمواهب التكنولوجية، مما يضيف إلى الخبرة المذهلة التي جلبها موظفونا في لندن منذ البداية.

Source link